中國/廣州 歐盟人工智能法案將于2024年強制執行, 為協助中國人工智能相關企業提前應對即將到來的國際監管,TÜV南德意志集團(以下簡稱“TÜV南德”)已推出人工智能評估服務:AI 質量架構評估方案。

本文為Trust AI@TÜV SÜD的系列專欄的第十篇:NIST 人工智能風險管理框架

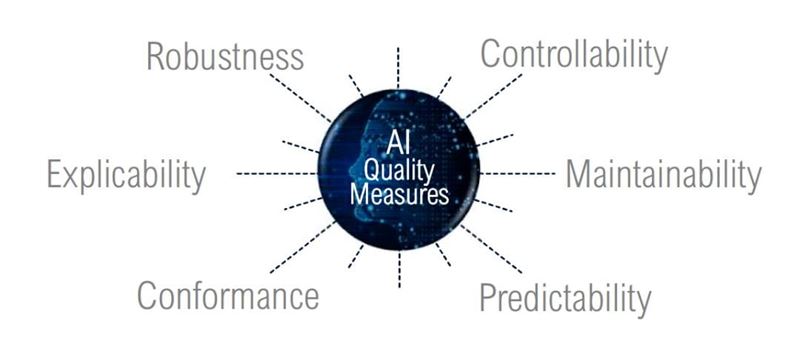

(AI 質量架構評估方案)

本期我們來關注北美的人工智能監管活動,討論NIST發布的人工智能風險管理框架(Artificial Intelligence Risk Management Framework,簡稱AI RMF)。

美國國家標準技術研究所(NIST,National Institute of Standards and Technology)成立于1901年,隸屬于美國商務部,是全球頂級的物理科學,測量學研究機構和標準化組織,致力于促進創新和產業競爭力,增強經濟安全和改善人類生活質量。

2023年1月,NIST發布了第一版人工智能風險管理框架AI RMF,其目標是幫助設計、開發、部署或使用人工智能系統的組織提高人工智能風險管理的能力,并促進人工智能系統的可信度和負責任的開發和使用。雖然AI RMF只是一個自愿性的技術框架,但這一框架在正式發布前NIST已經通過幾版公開的草稿版本,與人工智能學界和產業界進行了廣泛的信息收集和討論,并受到廣泛關注,因此,此次AI RMF一經發布即成為業界公認的人工智能風險管理指導體系。

AI RMF將與人工智能系統相關的潛在危害大致分為三類,即對人類的危害、對組織的危害和對生態系統的危害。

當前對這些危害的有效測量與管理還存在著很多挑戰。譬如,在AI系統中使用第三方軟硬件和數據難以管理;目前缺乏對風險和可信度的穩定且可驗證的度量方法的共識;對不同人工智能用例的適用性;在人工智能生命周期的不同階段測量風險可能會產生與不同的結果;在實驗室或受控環境中測量的人工智能的風險,可能會不同于在真實操作環境中出現的風險;不確定性的/有限解釋性的人工智能系統會使風險測量復雜化;用于增強或代替人類決策的AI,很難以人類的行為作為基準進行比較和評估等等。

AI RMF框架并不是一種萬能的解決方案,它需要根據組織的特定需求進行定制和實施。此外,該框架只是一個指導性工具,組織需要根據其實際情況進行判斷和決策,制定相應的措施,在實踐中建立組織的人工智能管理體系,并動態的持續改進。

增強AI的可信度可以在一定程度上降低AI的負面風險,AI RMF提出了7個可信賴AI的特征,分別是:有效&可靠,安全,彈性,可解釋,隱私保護,公平,可問責&透明。NIST希望可以通過AI RMF帶來如下改善:

AI RMF的核心工作是將AI風險管理分為了四大板塊:治理,映射,測量,管理。每一個模塊都再細分為更小的子分類,并且包括了具體的行動和結果。

為了方便人工智能相關組織和個人參考,NIST為AI RMF編制了簡明的指導書,將各模塊的具體信息以表格的型式陳列。AI RMF框架和指導書都已免費公開,有興趣的相關人員可以直接下載參考。本文就不再贅述。

以下為AI RMF中總結的人工智能相較于傳統軟件所增加的風險:

對于人工智能開發企業和應用企業,人工智能的風險以及質量都是至關重要的。除了性能以外,人工智能在自主性,公平性,透明性與可解釋性,數據保護,信息安全,可靠性與魯棒性等格方面的風險都要得到有效的評估和控制。人工智能的風險管理應貫穿于從概念,開發,部署,運營直到退役的全生命周期。

TÜV南德作為全球領先的TIC (Testing, Inspection, Certification) 機構,在人工智能的審計領域也有著堅實的基礎。TÜV南德全球數字服務中心首席技術官Martin Saebeck博士是ISO與IEC的聯合技術委員會JTC 1/SC 42標準工作組的核心成員,并正在主持多項人工智能國際標準的起草工作。此外TÜV南德全領域的專家深入參與了各垂直領域,如醫療設備、自動駕駛、機械安全等的國際法規與標準起草工作。

在大中華區,TÜV南德也組建了專業的人工智能評估團隊,該團隊由TÜV南德大中華區商用產品和交通服務部高級副總裁Robert Puto先生領導,旨在幫助中國企業高質量的應用人工智能技術,開發并提供可信賴的人工智能相關產品與服務,經由TÜV南德的合規性檢查及技術評估達到國際市場準入標準,并提供全生命周期的保障服務。

Site Selector

Global

Americas

Asia

Europe

Middle East and Africa